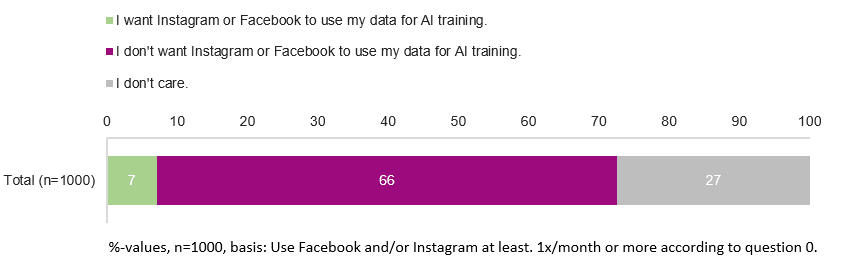

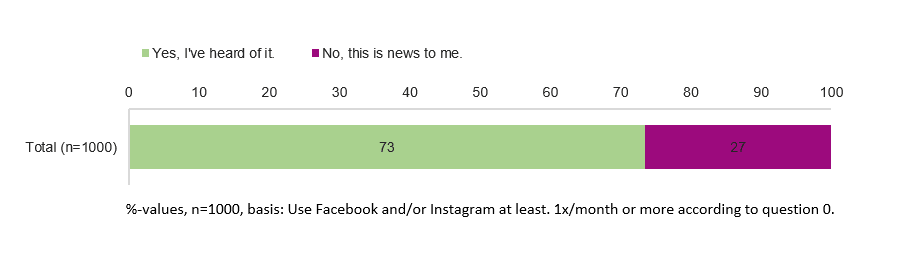

Meta niedawno zaczęła wykorzystywać dane osobowe Europejczyków do szkolenia AI. W przeciwieństwie do swoich zobowiązań wynikających z RODO, Meta nie poprosiła o zgodę z wyprzedzeniem. Zamiast tego firma twierdzi, że ma "uzasadniony interes" przeważający nad podstawowym prawem do prywatności. Kluczowym argumentem przemawiającym za takim "uzasadnionym interesem" są uzasadnione oczekiwania użytkowników. Nasuwa się pytanie: czy ludzie chcą, aby tak się stało? Aby dowiedzieć się więcej, noyb zlecił Instytutowi Gallupa przeprowadzenie badania wśród 1000 użytkowników Meta w Niemczech. Wyniki są jasne: podczas gdy prawie 75% użytkowników słyszało o planach Mety, tylko 7% faktycznie chce, aby ich dane były wykorzystywane do szkolenia AI. Oznacza to również, że co najmniej 68 milionów ludzi nigdy nie słyszało o tej zmianie.

- Pełne badanie na temat Meta AI - Perspektywa osób dotkniętych (EN)

- Tabela opracowana przez Instytut Gallupa

Prawie nikt nie chce, aby jego dane były wykorzystywane do szkolenia Meta AI. Zamiast pytać użytkowników o zgodę na mocy art. 6 ust. 1 lit. a) RODO, Meta wybrała podejście "walca parowego" do szkolenia swoich systemów sztucznej inteligencji z wykorzystaniem danych osobowych UE, po prostu twierdząc, że ma "uzasadniony interes" na mocy art. 6 ust. 1 lit. f) RODO, który jest nadrzędny wobec podstawowego prawa do ochrony danych użytkowników w UE. Głównym czynnikiem pozwalającym ustalić, czy taki "uzasadniony interes" istnieje, jest przyjrzenie się uzasadnionym oczekiwaniom użytkowników. Aby uzyskać naukowo wiarygodne dane na temat życzeń ludzi, noyb zlecił Instytutowi Gallupa przeprowadzenie reprezentatywnego badania wśród 1000 użytkowników Meta w Niemczech. Wyniki są jasne: 27% użytkowników nawet nie słyszało o planach Mety, a zatem nie miało żadnych rozsądnych oczekiwań. Co ważniejsze, tylko 7% faktycznie chce, aby ich dane osobowe były wykorzystywane do szkolenia AI.

Max Schrems, przewodniczący noyb: "Meta prawdopodobnie wie, że nikt nie chce udostępniać danych ze swoich kont w mediach społecznościowych tylko po to, aby Meta uzyskała przewagę konkurencyjną nad innymi firmami zajmującymi się sztuczną inteligencją, które nie mają dostępu do takich danych. Zamiast poprosić o zgodę i uzyskać odpowiedź "nie", po prostu zdecydowali, że ich prawo do zysków jest nadrzędne wobec prawa do prywatności co najmniej 274 milionów użytkowników w UE"

Meta upewniła się, że mniej niż 50% użytkowników zobaczyło ostrzeżenia. Pomimo faktu, że prawie dwie trzecie respondentów twierdzi, że słyszało o ogłoszeniu Mety, nie jest to zasługa własnych wysiłków firmy. Tylko 40% użytkowników Instagrama pamięta, że widziało powiadomienie w aplikacji, które było ukryte w menu powiadomień. Podobnie, tylko 39% użytkowników Facebooka pamięta powiadomienie e-mail, które zostało wysłane przy użyciu tematu, który miał na celu zignorowanie wiadomości e-mail. Świadomość drastycznie wzrasta wraz z wiekiem. Tylko 21% respondentów w wieku 16-30 lat pamięta, że Meta ich informowała, podczas gdy 48% osób w wieku powyżej 60 lat pamięta. Jeśli 73% z co najmniej 274 milionów użytkowników Meta słyszało o zmianie, a 27% nie, oznacza to, że 68,5 miliona osób nigdy nie zdawało sobie sprawy, że Meta zaczęła nieodwracalnie wprowadzać ich dane do systemu sztucznej inteligencji, pomimo ogromnego oburzenia opinii publicznej. Inne firmy, które nie mają tak szerokiego zasięgu medialnego, prawdopodobnie miałyby nawet mniej możliwości informowania ludzi.

Mężczyźni są bardziej skłonni do przekazywania swoich danych niż kobiety. Co ciekawe, istnieje również różnica między płciami w chęci zezwolenia firmie Meta na wykorzystanie danych osobowych do szkolenia AI. Podczas gdy 10% mężczyzn stwierdziło, że chce, aby firma wprowadziła ich dane do swoich systemów sztucznej inteligencji, tylko 4% kobiet stwierdziło, że chce, aby tak się stało.

Kleanthi Sardeli, prawnik ds. ochrony danych w noyb: "Nie ma dowodów na to, że Meta spełniła kryteria prawne dotyczące informowania użytkowników i ich uzasadnionych oczekiwań, że Meta wykorzysta lata ich aktywności w mediach społecznościowych do szkolenia AI"

Nie tylko niezgodne z prawem, ale także niepożądane. Wyniki ankiety wyraźnie pokazują, że - pomijając fakt, że podejście Mety narusza RODO - europejscy użytkownicy nie chcą, aby firma wprowadzała ich dane osobowe do swoich systemów sztucznej inteligencji. noyb wysłał już do firmy Meta tzw pismo o zaprzestaniu działalności i obecnie ocenia potencjalny pozew zbiorowy. Meta byłaby wówczas również odpowiedzialna za szkody wyrządzone konsumentom. Gdyby szkody niematerialne wyniosły 500 euro na użytkownika, wyniosłyby one około 137 miliardów euro dla co najmniej 274 milionów użytkowników Meta w Unii Europejskiej.