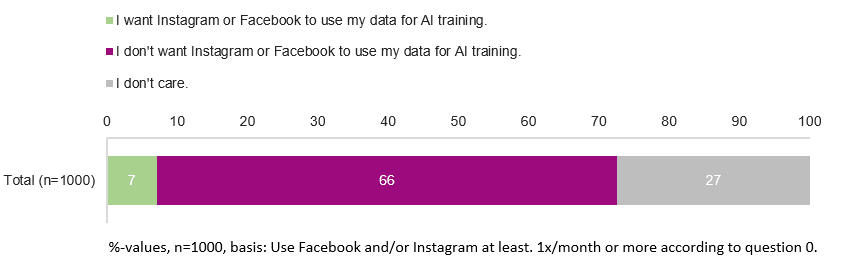

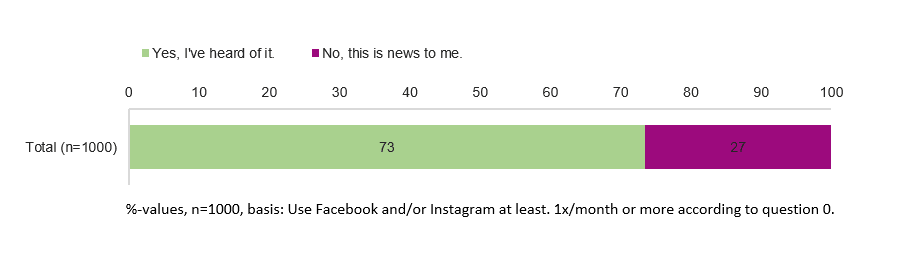

Meta a récemment commencé à utiliser les données personnelles des Européens pour la formation à l'IA. Contrairement à ses obligations au titre du GDPR, Meta n'a pas demandé de consentement préalable. Au lieu de cela, l'entreprise prétend avoir un "intérêt légitime" qui l'emporte sur le droit fondamental à la vie privée. L'un des principaux arguments en faveur d'un tel "intérêt légitime" est l'attente raisonnable des utilisateurs. La question qui se pose est la suivante : les gens veulent-ils que cela se produise ? Pour en savoir plus, noyb a demandé à l'institut Gallup de mener une étude auprès de 1 000 utilisateurs de Meta en Allemagne. Les résultats sont clairs : si près de 75 % des utilisateurs ont entendu parler des projets de Meta, seuls 7 % d'entre eux souhaitent que leurs données soient utilisées pour l'entraînement à l'IA. Cela signifie également qu'au moins 68 millions de personnes n'ont jamais entendu parler de ce changement.

- Étude complète sur Meta AI - Perspective des personnes concernées (EN)

- Compilation de tableaux par l'Institut Gallup

Presque personne ne souhaite que ses données soient utilisées pour former l'IA de Meta. Au lieu de demander le consentement des utilisateurs en vertu de l'article 6, paragraphe 1, point a), du GDPR, Meta a choisi une approche de rouleau compresseur pour former ses systèmes d'IA avec les données personnelles de l'UE en prétendant simplement avoir un "intérêt légitime" en vertu de l'article 6, paragraphe 1, point f), du GDPR, qui l'emporte sur le droit fondamental à la protection des données des utilisateurs de l'UE. Pour déterminer l'existence d'un tel "intérêt légitime", il est essentiel d'examiner les attentes raisonnables des utilisateurs. Obtenir des données scientifiquement fiables sur les souhaits des personnes, noyb a demandé à l'institut Gallup de mener une étude représentative auprès de 1 000 utilisateurs de Meta en Allemagne. Les résultats sont clairs : 27 % des utilisateurs n'ont même pas entendu parler des projets de Meta et n'ont donc pas d'attentes raisonnables. Plus important encore, seuls 7 % d'entre eux souhaitent que leurs données personnelles soient utilisées pour l'entraînement à l'IA.

Max Schrems, président du noyb: "Meta sait probablement que personne ne veut fournir les données de ses comptes de médias sociaux, juste pour que Meta obtienne un avantage concurrentiel sur les autres entreprises d'IA qui n'ont pas accès à ces données. Au lieu de demander le consentement et d'obtenir une réponse négative, Meta a décidé que son droit au profit l'emportait sur le droit à la vie privée d'au moins 274 millions d'utilisateurs de l'UE

Meta a fait en sorte que moins de 50 % des utilisateurs voient les avertissements. Bien que près de deux tiers des personnes interrogées affirment avoir entendu parler de l'annonce de Meta, ce n'est pas grâce aux efforts de l'entreprise elle-même. Seuls 40 % des utilisateurs d'Instagram se souviennent avoir vu la notification in-app qui était cachée dans un menu de notification. De même, seuls 39 % des utilisateurs de Facebook se souviennent de la notification par courriel envoyée avec un objet visant à ce que les gens ignorent le courriel. La prise de conscience augmente considérablement avec l'âge. Seuls 21 % des répondants âgés de 16 à 30 ans se souviennent d'avoir été informés par Meta, tandis que 48 % des personnes de plus de 60 ans s'en souviennent. Si 73 % des 274 millions d'utilisateurs de Meta ont entendu parler du changement et que 27 % ne l'ont pas fait, cela signifie que 68,5 millions de personnes n'ont jamais réalisé que Meta a commencé à alimenter de manière irréversible un système d'intelligence artificielle avec leurs données, malgré l'indignation générale. D'autres entreprises qui ne bénéficient pas d'une couverture médiatique aussi large auraient probablement moins de possibilités d'informer les gens.

Les hommes sont plus disposés à transmettre leurs données que les femmes. Il est intéressant de noter qu'il existe également une différence entre les sexes en ce qui concerne la volonté d'autoriser Meta à utiliser des données personnelles pour l'entraînement à l'IA. Alors que 10 % des hommes ont déclaré qu'ils souhaitaient que l'entreprise introduise leurs données dans ses systèmes d'IA, seulement 4 % des femmes ont dit qu'elles souhaitaient que cela se produise.

Kleanthi Sardeli, avocate spécialisée dans la protection des données chez noyb: "Il n'y a aucune preuve que Meta ait rempli les critères légaux d'information des utilisateurs et qu'ils aient des attentes raisonnables que Meta utilise des années de leur activité sur les médias sociaux pour l'entraînement à l'IA."

Ce n'est pas seulement illégal, c'est aussi indésirable. Les résultats de l'enquête montrent clairement que - outre le fait que l'approche de Meta viole le GDPR - les utilisateurs européens ne veulent pas que l'entreprise introduise leurs données personnelles dans ses systèmes d'IA. noyb a déjà envoyé à Meta une lettre de lettre de cessation et de désistement et évalue actuellement la possibilité d'une action collective. Meta serait alors également responsable des dommages subis par les consommateurs. Si le préjudice moral était de 500 euros par utilisateur, il s'élèverait à environ 137 milliards d'euros pour au moins 274 millions d'utilisateurs de Meta dans l'Union européenne.