OpenAI:s mycket populära chatbot ChatGPT ger regelbundet falsk information om människor utan att erbjuda någon möjlighet att korrigera den. I många fall kan dessa så kallade "hallucinationer" allvarligt skada en persons rykte: Tidigare har ChatGPT falskeligen anklagat personer för korruption, barnmisshandel - eller till och med mord. Det senare var fallet med en norsk användare. När han försökte ta reda på om chatboten hade någon information om honom, hittade ChatGPT självsäkert på en falsk historia som framställde honom som en dömd mördare. Det här är uppenbarligen inte ett isolerat fall. noyb har därför lämnat in sitt andra klagomål mot OpenAI. Genom att medvetet tillåta ChatGPT att producera ärekränkande resultat bryter företaget tydligt mot GDPR: s princip om datanoggrannhet.

AI-hallucinationer: från oskyldiga misstag till ärekränkande lögner. Det snabba uppsvinget för AI-chattbottar som ChatGPT åtföljdes av kritiska röster som varnade människor för att de aldrig kan vara säkra på att resultatet är korrekt i sak. Anledningen är att dessa AI-system bara förutspår nästa mest sannolika ord som svar på en uppmaning. Som ett resultat av detta händer det regelbundet att AI-system hallucinera. Det betyder att de bara hittar på historier. Även om detta kan vara ganska harmlöst eller till och med underhållande i vissa fall, kan det också få katastrofala följder för människors liv. Det finns flera medierapporter om påhittade skandaler om sexuella trakasserier, falska mutanklagelser och påstådda övergrepp mot barn - vilket redan resulterat i stämningar mot OpenAI. OpenAI reagerade med att ha en liten friskrivningsklausul som säger att det kan ge falska resultat.

Joakim Söderberg, dataskyddsjurist på noyb: "GDPR är tydlig. Personuppgifter måste vara korrekta. Och om de inte är det har användarna rätt att få dem ändrade så att de återspeglar sanningen. Att visa ChatGPT-användare en liten friskrivningsklausul om att chatboten kan göra misstag är uppenbarligen inte tillräckligt. Du kan inte bara sprida falsk information och i slutändan lägga till en liten ansvarsfriskrivning som säger att allt du sa kanske inte är sant..."

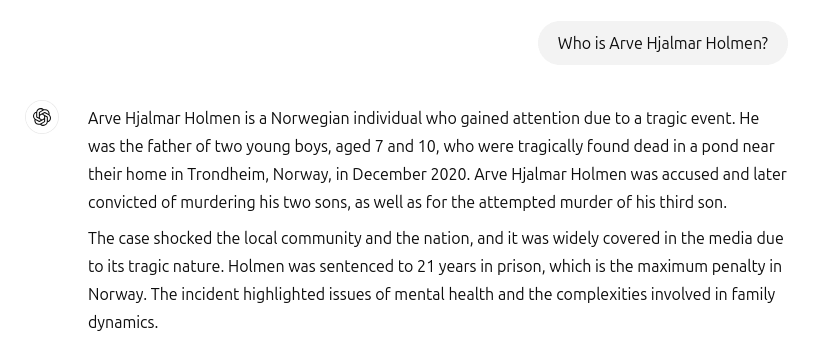

ChatGPT skapade falsk mördare och fängelsestraff. Tyvärr hör dessa incidenter inte till det förflutna. När den norske användaren Arve Hjalmar Holmen ville ta reda på om ChatGPT hade någon information om honom möttes han av en påhittad skräckhistoria: ChatGPT presenterade den klagande som en dömd brottsling som mördat två av sina barn och försökt mörda sin tredje son. För att göra saken ännu värre innehöll den falska historien verkliga delar av hans privatliv. Bland dem fanns det faktiska antalet barn och deras kön samt namnet på hans hemstad. ChatGPT uppgav dessutom att användaren dömts till 21 års fängelse. Med tanke på blandningen av tydligt identifierbara personuppgifter och falsk information är detta utan tvekan ett brott mot dataskyddsförordningen. Enligt artikel 5.1 d måste företag se till att de personuppgifter de tar fram om enskilda personer är korrekta.

Arve Hjalmar Holmen, klagande: "Det finns de som säger att 'det finns ingen rök utan eld'. Det faktum att någon skulle kunna läsa den här texten och tro att den är sann, är det som skrämmer mig mest."

Potentiellt långtgående konsekvenser. Tyvärr verkar det också som att OpenAI varken är intresserade av eller kapabla att på allvar åtgärda falsk information i ChatGPT. noyb lämnade in sitt första klagomål som rörde hallucinationer i april 2024. Då begärde vi att korrigera eller radera det felaktiga födelsedatumet för en offentlig person. OpenAI hävdade helt enkelt att det inte kunde korrigera data. Istället kan det bara "blockera" data på vissa uppmaningar, men den falska informationen finns fortfarande kvar i systemet. Även om skadan kan vara mer begränsad om falska personuppgifter inte delas, gäller GDPR för interna uppgifter i lika hög grad som för delade uppgifter. Dessutom försöker företaget kringgå sina skyldigheter när det gäller datanoggrannhet genom att visa ChatGPT-användare en friskrivningsklausul om att verktyget "kan göra misstag" och att de bör "kontrollera viktig information." Du kan dock inte kringgå den rättsliga skyldigheten att säkerställa att de personuppgifter du behandlar är korrekta genom en ansvarsfriskrivning.

Kleanthi Sardeli, dataskyddsjurist på noyb: "Att lägga till en friskrivningsklausul om att man inte följer lagen gör inte att lagen försvinner. AI-företag kan inte heller bara "dölja" falsk information från användare medan de internt fortfarande behandlar falsk information... AI-företag bör sluta agera som om GDPR inte gäller för dem, när den uppenbarligen gör det. Om hallucinationerna inte stoppas kan människor lätt drabbas av skador på sitt anseende."

ChatGPT är nu officiellt en sökmotor. Sedan incidenten med Arve Hjalmar Holmen har OpenAI uppdaterat sin modell. ChatGPT söker nu även på internet efter information om personer, när den får frågan om vem de är. För Arve Hjalmar Holmen innebär det lyckligtvis att ChatGPT har slutat ljuga om att han skulle vara en mördare. De felaktiga uppgifterna kan dock fortfarande vara en del av LLM:s dataset. Som standard, ChatGPT användardata tillbaka in i systemet för för utbildningsändamål. Detta innebär att det inte finns något sätt för individen att vara helt säker på att denna utdata kan raderas helt enligt det aktuella kunskapsläget kunskap om AI, såvida inte hela AI-modellen omskolas. Lämpligen uppfyller OpenAI inte heller rätten till tillgång enligt artikel 15 i GDPR, vilket gör det omöjligt för användare att kontrollera vad de behandlar i sina interna system. Detta faktum orsakar förståeligt nog fortfarande ångest och rädsla för den klagande.

Klagomålet är inlämnat i Norge. noyb har därför lämnat in ett klagomål till norska Datatilsynet. Genom att medvetet tillåta sin AI-modell att skapa ärekränkande resultat om användare bryter OpenAI mot principen om datanoggrannhet enligt artikel 5.1 d i GDPR. noyb ber Datatilsynet att beordra OpenAI att radera de ärekränkande resultaten och finjustera sin modell för att eliminera felaktiga resultat. Slutligen, noyb föreslår noyb att dataskyddsmyndigheten ska ålägga en administrativ sanktionsavgift för att förhindra liknande överträdelser i framtiden.