Το εξαιρετικά δημοφιλές chatbot του OpenAI, το ChatGPT, παρέχει τακτικά ψευδείς πληροφορίες για άτομα χωρίς να προσφέρει κανέναν τρόπο διόρθωσής τους. Σε πολλές περιπτώσεις, αυτές οι αποκαλούμενες «παραισθήσεις» μπορούν να βλάψουν σοβαρά τη φήμη ενός ατόμου: Στο παρελθόν, το ChatGPT κατηγορούσε ψευδώς άτομα για διαφθορά , κακοποίηση παιδιών – ή ακόμα και φόνο. Το τελευταίο συνέβη με έναν Νορβηγό χρήστη. Όταν προσπάθησε να μάθει αν το chatbot είχε πληροφορίες για αυτόν, το ChatGPT έφτιαξε με σιγουριά μια ψεύτικη ιστορία που τον απεικόνιζε ως καταδικασμένο δολοφόνο. Αυτό σαφώς δεν είναι μια μεμονωμένη περίπτωση. Ως εκ τούτου, η noyb υπέβαλε τη δεύτερη καταγγελία της κατά του OpenAI. Επιτρέποντας εν γνώσει της στο ChatGPT να παράγει δυσφημιστικά αποτελέσματα, η εταιρεία σαφώς παραβιάζει την αρχή της ακρίβειας δεδομένων του GDPR.

Παραισθήσεις AI: από αθώα λάθη έως δυσφημιστικά ψέματα. Η ταχεία άνοδος των chatbot AI όπως το ChatGPT συνοδεύτηκε από επικριτικές φωνές που προειδοποιούσαν τους ανθρώπους ότι δεν μπορούν ποτέ να είναι σίγουροι ότι η έξοδος είναι πραγματικά σωστή. Ο λόγος είναι ότι αυτά τα συστήματα τεχνητής νοημοσύνης προβλέπουν απλώς την επόμενη πιο πιθανή λέξη ως απάντηση σε μια προτροπή. Ως αποτέλεσμα, τα συστήματα AI έχουν τακτικά παραισθήσεις . Αυτό σημαίνει ότι απλώς φτιάχνουν ιστορίες. Αν και αυτό μπορεί να είναι αρκετά ακίνδυνο ή ακόμα και διασκεδαστικό σε ορισμένες περιπτώσεις, μπορεί επίσης να έχει καταστροφικές συνέπειες για τις ζωές των ανθρώπων. Υπάρχουν πολλές αναφορές στα μέσα ενημέρωσης για επινοημένα σκάνδαλα σεξουαλικής παρενόχλησης , ψευδείς κατηγορίες για δωροδοκία και υποτιθέμενη παιδική παρενόχληση – που ήδη είχαν ως αποτέλεσμα μηνύσεις κατά του OpenAI. Το OpenAI αντέδρασε έχοντας μια μικρή δήλωση αποποίησης ευθυνών λέγοντας ότι μπορεί να παράγει ψευδή αποτελέσματα.

Joakim Söderberg, δικηγόρος προστασίας δεδομένων στο noyb: "Οι προσωπικές πληροφορίες πρέπει να είναι ακριβείς, οι χρήστες έχουν το δικαίωμα να τις αλλάξουν για να αντικατοπτρίζουν την αλήθεια."

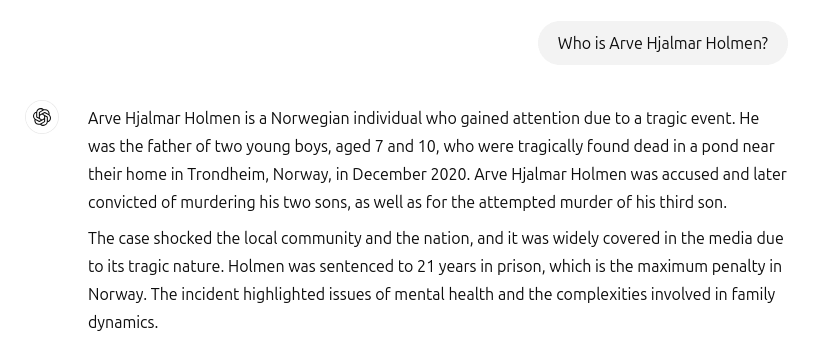

Το ChatGPT δημιούργησε ψεύτικο δολοφόνο και φυλάκιση. Δυστυχώς, αυτά τα περιστατικά δεν ανήκουν στο παρελθόν. Όταν ο Νορβηγός χρήστης Arve Hjalmar Holmen ήθελε να μάθει εάν το ChatGPT είχε πληροφορίες για αυτόν, ήρθε αντιμέτωπος με μια επινοημένη ιστορία τρόμου: το ChatGPT παρουσίασε τον καταγγέλλοντα ως καταδικασμένο εγκληματία που δολοφόνησε δύο από τα παιδιά του και αποπειράθηκε να δολοφονήσει τον τρίτο γιο του. Για να κάνει τα πράγματα χειρότερα, η ψεύτικη ιστορία περιελάμβανε πραγματικά στοιχεία της προσωπικής του ζωής. Μεταξύ αυτών ήταν ο πραγματικός αριθμός και το φύλο των παιδιών του και το όνομα της πόλης του. Επιπλέον, το ChatGPT δήλωσε επίσης ότι ο χρήστης καταδικάστηκε σε 21 χρόνια φυλάκιση. Δεδομένου του συνδυασμού σαφώς αναγνωρίσιμων προσωπικών δεδομένων και πλαστών πληροφοριών, αυτό αποτελεί αναμφίβολα παραβίαση του GDPR. Σύμφωνα με το άρθρο 5 παράγραφος 1 στοιχείο δ), οι εταιρείες πρέπει να διασφαλίζουν ότι τα προσωπικά δεδομένα που παράγουν για άτομα είναι ακριβή.

Arve Hjalmar Holmen, καταγγέλλων: « Μερικοί πιστεύουν ότι «δεν υπάρχει καπνός χωρίς φωτιά» το γεγονός ότι κάποιος θα μπορούσε να διαβάσει αυτό το αποτέλεσμα και να πιστέψει ότι είναι αλήθεια .

Δυνητικά εκτεταμένες συνέπειες. Δυστυχώς, φαίνεται επίσης ότι το OpenAI δεν ενδιαφέρεται ούτε είναι ικανό να διορθώσει σοβαρά ψευδείς πληροφορίες στο ChatGPT. Η noyb υπέβαλε την πρώτη της καταγγελία σχετικά με παραισθήσεις τον Απρίλιο του 2024. Τότε, ζητήσαμε να διορθωθεί ή να διαγραφεί η εσφαλμένη ημερομηνία γέννησης ενός δημόσιου προσώπου. Το OpenAI απλώς υποστήριξε ότι δεν μπορούσε να διορθώσει τα δεδομένα. Αντίθετα, μπορεί να «μπλοκάρει» δεδομένα μόνο σε ορισμένες προτροπές, αλλά οι ψευδείς πληροφορίες παραμένουν στο σύστημα. Ενώ η ζημιά που προκαλείται μπορεί να είναι πιο περιορισμένη εάν δεν κοινοποιηθούν ψευδή προσωπικά δεδομένα, ο GDPR ισχύει τόσο για τα εσωτερικά δεδομένα όσο και για τα κοινά δεδομένα. Επιπλέον, η εταιρεία προσπαθεί να παρακάμψει τις υποχρεώσεις της όσον αφορά την ακρίβεια των δεδομένων δείχνοντας στους χρήστες του ChatGPT μια δήλωση αποποίησης ευθύνης ότι το εργαλείο «μπορεί να κάνει λάθη» και ότι πρέπει να «ελέγξουν σημαντικές πληροφορίες». Ωστόσο, δεν μπορείτε να παρακάμψετε τη νομική υποχρέωση να διασφαλίσετε την ακρίβεια των προσωπικών δεδομένων που επεξεργάζεστε μέσω δήλωσης αποποίησης ευθύνης.

Κλεάνθη Σαρδέλη, δικηγόρος προστασίας δεδομένων στο noyb: «Η προσθήκη μιας δήλωσης αποποίησης ευθύνης ότι δεν συμμορφώνεστε με το νόμο δεν εξαλείφει τον νόμο, οι εταιρείες τεχνητής νοημοσύνης δεν μπορούν απλώς να «κρύψουν» ψευδείς πληροφορίες από τους χρήστες ενώ εξακολουθούν να επεξεργάζονται εσωτερικά ψευδείς πληροφορίες.

Το ChatGPT είναι πλέον επίσημα μια μηχανή αναζήτησης. Από το περιστατικό σχετικά με τον Arve Hjalmar Holmen, το OpenAI έχει ενημερώσει το μοντέλο του. Το ChatGPT τώρα αναζητά επίσης στο διαδίκτυο πληροφορίες σχετικά με άτομα, όταν ρωτάται ποιοι είναι. Για τον Arve Hjalmar Holmen, αυτό ευτυχώς σημαίνει ότι το ChatGPT έχει σταματήσει να λέει ψέματα ότι είναι δολοφόνος. Ωστόσο, τα λανθασμένα δεδομένα ενδέχεται να εξακολουθούν να παραμένουν μέρος του συνόλου δεδομένων του LLM. Από προεπιλογή, το ChatGPT τροφοδοτεί τα δεδομένα χρήστη πίσω στο σύστημα για εκπαιδευτικούς σκοπούς. Αυτό σημαίνει ότι δεν υπάρχει κανένας τρόπος για το άτομο να είναι απολύτως βέβαιο ότι αυτή η έξοδος μπορεί να διαγραφεί πλήρως σύμφωνα με την τρέχουσα κατάσταση γνώσης σχετικά με την τεχνητή νοημοσύνη, εκτός και αν επανεκπαιδευτεί ολόκληρο το μοντέλο τεχνητής νοημοσύνης. Βολικά, το OpenAI δεν συμμορφώνεται ούτε με το δικαίωμα πρόσβασης βάσει του άρθρου 15 του GDPR, γεγονός που καθιστά αδύνατο για τους χρήστες να βεβαιωθούν τι επεξεργάζονται στα εσωτερικά τους συστήματα. Το γεγονός αυτό είναι κατανοητό ότι εξακολουθεί να προκαλεί αγωνία και φόβο στον καταγγέλλοντα.

Καταγγελία που υποβλήθηκε στη Νορβηγία. Ως εκ τούτου, η noyb υπέβαλε καταγγελία στη νορβηγική Datatilsynet. Επιτρέποντας εν γνώσει του το μοντέλο τεχνητής νοημοσύνης του να δημιουργεί δυσφημιστικά αποτελέσματα για τους χρήστες, το OpenAI παραβιάζει την αρχή της ακρίβειας των δεδομένων σύμφωνα με το άρθρο 5 παράγραφος 1 στοιχείο δ) του GDPR. Η noyb ζητά από το Datatilsynet να διατάξει το OpenAI να διαγράψει το δυσφημιστικό αποτέλεσμα και να βελτιώσει το μοντέλο του για να εξαλείψει τα ανακριβή αποτελέσματα. Τέλος, η noyb προτείνει η αρχή προστασίας δεδομένων να επιβάλει διοικητικό πρόστιμο για να αποτρέψει παρόμοιες παραβιάσεις στο μέλλον.