Plainte GDPR : les hôtes d'Airbnb à la merci des algorithmes

Aujourd'hui, noyb.eu a déposé une plainte GDPR contre Airbnb. La place de marché en ligne pour les locations de vacances a dégradé la note du plaignant en tant qu'hôte, uniquement par le biais d'une prise de décision automatisée. Alors que chacun a le droit de ne pas être soumis à une prise de décision automatisée, Airbnb s'appuie exactement sur ces pratiques. En refusant au plaignant la possibilité de contester la décision automatisée et d'obtenir une intervention humaine, Airbnb a agi en violation manifeste du GDPR.

- Plainte contre Airbnb auprès de l'autorité de protection des données de Rheinland-Pfalz (EN)

- Plainte contre Airbnb auprès de l'autorité de protection des données de Rhénanie-Palatinat (DE)

Garanties contre la prise de décision automatisée. La prise de décision automatisée (ADM) est un type de traitement qui est réglementé par le GDPR afin de protéger les personnes contre les décisions injustes prises par des moyens automatisés, tels que les algorithmes. Les droits prévus par l'article 22(3) GDPR comprennent le droit pour la personne concernée d'exprimer son point de vue, le droit de contester la décision automatisée et le droit d'obtenir une intervention humaine significative. Dans ce cas, Airbnb n'a pas seulement omis d'informer correctement l'hôte de l'existence d'un tel SMA, ils lui ont également refusé la possibilité de contester efficacement la décision, ce qui a entraîné une perte financière substantielle pour les hôtes.

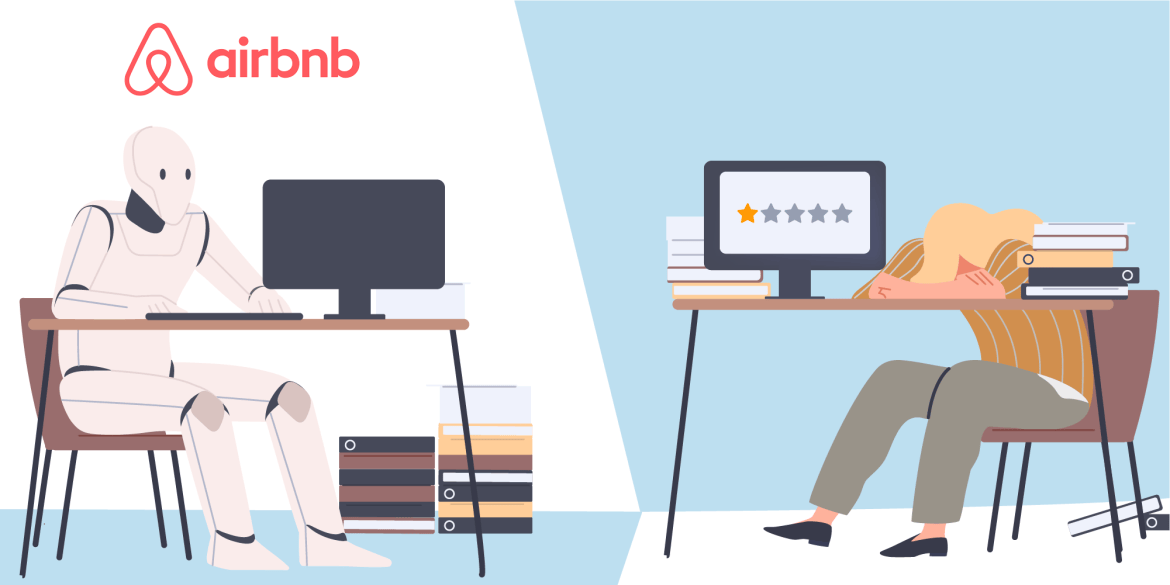

Les évaluations sont essentielles pour devenir un "superhôte". Airbnb met en relation des hôtes louant des espaces de vie avec des hôtes potentiels. Après chaque séjour, les hôtes donnent une note allant de une à cinq étoiles. Naturellement, les locations avec de bons avis ont plus de chances d'être réservées, ce qui rend les avis particulièrement importants pour les hôtes Airbnb. S'ils atteignent et maintiennent une note moyenne de 4,8 étoiles, ils deviennent des "Superhosts", ce qui leur confère de nombreux avantages, tels qu'une meilleure visibilité sur la plateforme, des revenus locatifs globaux plus élevés et un bon de voyage de 100 € par an.

Des algorithmes pour vérifier les avis. Comme des milliers d'avis sont laissés chaque jour, Airbnb s'appuie sur des algorithmes pour vérifier si ces avis sont conformes à sa politique d'avis. Les avis qui sont biaisés ou non pertinents sont automatiquement supprimés par ces algorithmes. Les erreurs peuvent avoir des conséquences dramatiques sur les hôtes Airbnb : si des avis 5 étoiles sont supprimés par erreur, cela peut les priver de leur statut de Superhost, et de tous les avantages qui en découlent - comme ce fut le cas pour le plaignant.

"Un décideur distant et injoignable peut supprimer un " simple " avis sur une plateforme. Mais dans d'autres cas, les algorithmes abaissent automatiquement la note financière de quelqu'un, évaluent ses performances professionnelles ou même licencient des travailleurs. C'est ce que nous risquons si nous n'établissons pas le principe selon lequel les algorithmes doivent être transparents et leurs décisions responsables "Stefano Rossetti, avocat spécialisé dans la protection des données chez noyb.eu

Desavis automatiquement supprimés par Airbnb. Dans le cas de la plaignante, un avis cinq étoiles a été automatiquement supprimé par Airbnb. En conséquence, sa note globale a été revue à la baisse. Elle a immédiatement contacté Airbnb pour expliquer les raisons et contester la décision, mais l'entreprise s'est contentée de répondre que la suppression était "définitive". En conséquence, l'hôte a contacté le délégué à la protection des données d'Airbnb pour obtenir plus d'informations sur le traitement de ses données personnelles et la suppression automatisée des évaluations. Aujourd'hui encore, 1,5 an après sa demande d'accès, elle n'a toujours pas reçu de réponse d'Airbnb. Selon le GDPR, ils avaient un mois pour répondre.

"Pour Airbnb, la suppression des avis est une simple routine. Mais pour moi, cela peut avoir des conséquences graves. S'ils étaient un vrai partenaire, ils ne traiteraient pas leurs hôtes de la sorte [...]. Je ne veux pas vivre dans un monde où une partie de mon gagne-pain dépend de la décision d'un algorithme" -July (alias), le plaignant dans cette affaire

Des hôtes à la merci des algorithmes. Le système d'Airbnb - où des algorithmes patrouillent les plateformes et suppriment automatiquement les avis sans intervention humaine - est un type de prise de décision automatisée (ADM) qui peut avoir un impact significatif sur les hôtes Airbnb. En vertu du GDPR, tout individu qui fait l'objet d'une ADM, a le droit de contester la décision et d'obtenir un examen humain significatif de son cas, où toutes les circonstances pertinentes sont prises en compte. Airbnb ne respecte clairement pas ces normes. Les hôtes sont donc laissés à la merci des algorithmes, sans réelle possibilité de se défendre. Des algorithmes similaires dominent également la vie et le travail de nombreux autres travailleurs de la "gig economy", des chauffeurs Uber aux livreurs.