Denuncia del GDPR: los anfitriones de Airbnb están a merced de los algoritmos

Hoy, noyb.eu ha presentado una denuncia contra Airbnb en virtud del GDPR. El mercado online de alquileres vacacionales rebajó la calificación del denunciante como anfitrión, únicamente mediante la toma de decisiones automatizada. Aunque todo el mundo tiene derecho a no ser sometido a una toma de decisiones automatizada, Airbnb se basa exactamente en estas prácticas. Al negar la oportunidad al denunciante de impugnar la decisión automatizada y obtener la intervención humana, Airbnb actuó en clara violación del GDPR.

- Reclamación contra Airbnb ante la Autoridad de Protección de Datos de Renania-Palatinado (EN)

- Reclamación contra Airbnb ante la Autoridad de Protección de Datos de Renania-Palatinado (DE)

Salvaguardias contra la toma de decisiones automatizada. La toma de decisiones automatizada (ADM) es un tipo de tratamiento que está regulado por el GDPR para proteger a las personas contra las decisiones injustas tomadas por medios automatizados, como los algoritmos. Los derechos previstos en el artículo 22.3 del RGPD incluyen el derecho del interesado a expresar su punto de vista, el derecho a impugnar la decisión automatizada y el derecho a obtener una intervención humana significativa. En este caso, Airbnb no solo no informó adecuadamente a la anfitriona de la existencia de dicha ADM, sino que le negó la posibilidad de impugnar efectivamente la decisión, lo que supuso un importante perjuicio económico para los anfitriones.

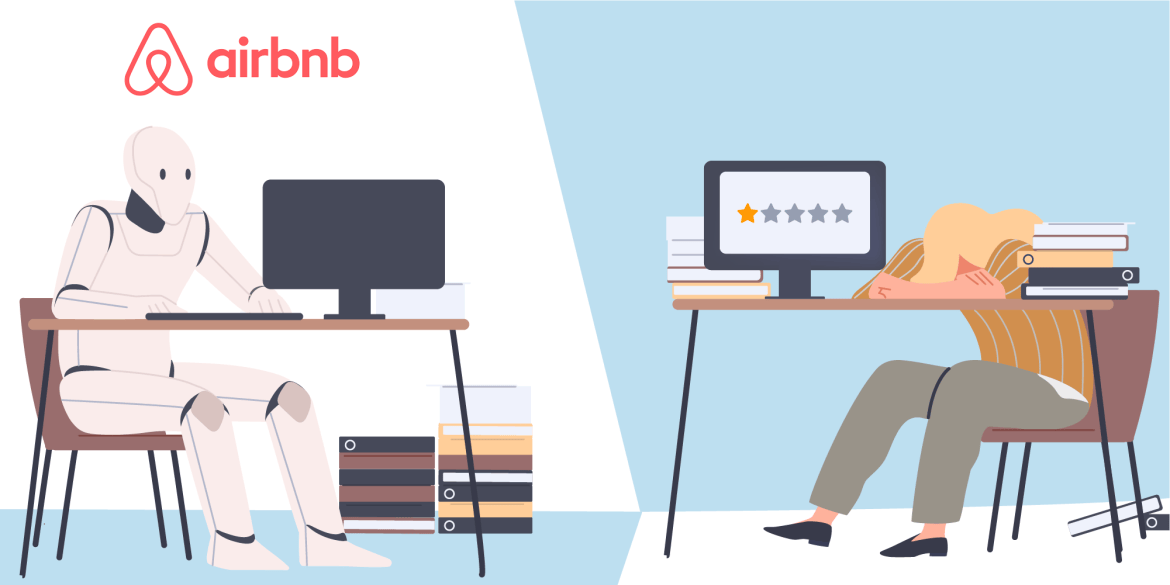

Revisiones esenciales para convertirse en "Superhost". Airbnb pone en contacto a los anfitriones que alquilan espacios vitales con los posibles huéspedes. Después de cada estancia, los huéspedes proporcionan una calificación de una a cinco estrellas. Naturalmente, los alquileres con buenas opiniones tienen más probabilidades de ser reservados, lo que hace que las opiniones sean especialmente importantes para los anfitriones de Airbnb. Si alcanzan y mantienen una puntuación media de 4,8 estrellas se convierten en "Superanfitriones", lo que conlleva muchas ventajas, como una mayor visibilidad en la plataforma, mayores ingresos por alquileres en general y un bono de viaje de 100 euros cada año.

Algoritmos para comprobar las opiniones. Dado que se dejan miles de opiniones cada día, Airbnb se basa en algoritmos para comprobar si estas opiniones cumplen con su Política de Opiniones. Los algoritmos eliminan automáticamente las opiniones sesgadas o irrelevantes. Los errores pueden tener consecuencias dramáticas para los anfitriones de Airbnb: si se eliminan reseñas de 5 estrellas por error, esto puede privarles de su estatus de Superhost, y de todas las ventajas que conlleva -como fue el caso del denunciante.

"Un responsable lejano e inalcanzable puede eliminar una "simple" reseña en una plataforma. Pero en otros casos los algoritmos bajan automáticamente la calificación económica de alguien, evalúan el rendimiento laboral o incluso despiden a los trabajadores. A eso nos arriesgamos si no establecemos el principio de que los algoritmos deben ser transparentes y sus decisiones responsables " - Stefano Rossetti, abogado de protección de datos en noyb.eu

Reseñas eliminadas automáticamente por Airbnb. En el caso del denunciante, una reseña de cinco estrellas fue eliminada automáticamente por Airbnb. Como consecuencia de ello, su calificación general fue rebajada. Inmediatamente se puso en contacto con Airbnb para explicar los motivos e impugnar la decisión, pero se limitaron a responder que la eliminación era "definitiva". En consecuencia, la anfitriona se puso en contacto con el responsable de protección de datos de Airbnb para obtener más información sobre el tratamiento de sus datos personales y la eliminación automática de las valoraciones. Todavía hoy, un año y medio después de su solicitud de acceso, no ha recibido ninguna respuesta de Airbnb. Según el GDPR, tenían un mes para responder.

"Para Airbnb, borrar reseñas es una mera rutina. Pero para mí, puede tener un efecto grave. Si fueran un socio de verdad, no tratarían así a sus anfitriones... No quiero vivir en un mundo en el que parte de mi sustento depende de la decisión de un algoritmo" -July (alias), la denunciante en este caso

Anfitriones a merced de los algoritmos. El sistema de Airbnb -en el que los algoritmos patrullan las plataformas y eliminan automáticamente las reseñas sin intervención humana- es un tipo de toma de decisiones automatizada (ADM) que puede tener un impacto significativo en los anfitriones de Airbnb. De acuerdo con el GDPR, cualquier persona que sea objeto de una ADM, tiene el derecho de impugnar la decisión y obtener una revisión humana significativa de su caso, donde se consideren todas las circunstancias relevantes. Airbnb claramente no cumple con estas normas. Por tanto, los anfitriones quedan a merced de los algoritmos, sin posibilidad real de defenderse. Algoritmos similares también dominan la vida y el trabajo de muchos otros trabajadores de la "economía gig", desde los conductores de Uber hasta los repartidores.