Das in Litauen ansässige Unternehmen Whitebridge AI verkauft „Reputationsberichte“ über alle Menschen mit Onlinepräsenz. Diese Berichte enthalten persönliche Informationen von ahnungslosen Personen – und werden an jeden verkauft, der dafür zahlt. Einige Daten sind faktisch falsch und KI-generiert. Sie umfassen unter anderem Vorschläge für Gesprächsthemen, eine Liste mutmaßlicher Persönlichkeitsmerkmale und einen "Background-Check". Dieser soll feststellen, ob du z.B. politische oder religiöse Inhalte geteilt hast. Trotz des gesetzlichen Auskunftsrechts verkauft Whitebridge.ai diese „Berichte“ an betroffene Personen. Es scheint, als basiere das Geschäftsmodell weitgehend auf verunsicherten Nutzer:innen, die ihre zuvor unrechtmäßig gesammelten Daten einsehen wollen. noyb hat nun eine Beschwerde bei der litauischen Datenschutzbehörde eingereicht.

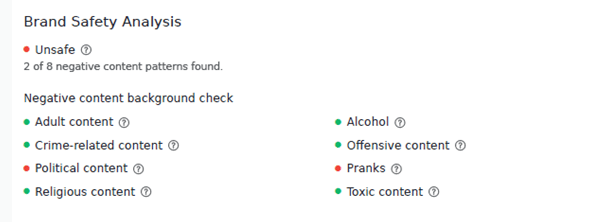

KI-gestützte „Reputationsberichte“. Auf seiner Website bewirbt Whitebridge.ai seine Dienste als KI-Tool, das „alles über dich im Internet findet“. Nutzer:innen wird vorgeschlagen, dass man „sich selbst, seinen Partner oder potenzielle Bewerber suchen“ kann. Die daraufhin erstellten Berichte umfassen Daten aus sozialen Medien, Erwähnungen in Nachrichtenberichten, Fotos, „versteckte Profile“ und „negative Presseberichte“. Das Tool führt auch eine Art „Background-Check“ durch, um festzustellen, ob man Inhalte für Erwachsene, kriminelle, toxische, politische oder religiöse Beiträge veröffentlicht hat. Die Ergebnisse sind meist von geringer Qualität und scheinen eher zufällig generierte KI-Texte zu sein, die auf unrechtmäßig gesammelten Onlinedaten basieren. Nicht zuletzt enthält der Bericht auch sogenannte „Interaktionsrichtlinien“ mit Verhaltensregeln für potenzielle Gespräche, eine Liste mit Persönlichkeitsmerkmalen, Vorlieben und eine Reihe von Fotos aus sozialen Medien und anderen Online-Quellen.

Angebot für die betroffenen Personen? Whitebridges Onlinewerbung scheint überraschenderweise hauptsächlich auf die betroffenen Personen selbst abzuzielen. Werbevideos enthalten Slogans wie „das ist irgendwie unheimlich” und „überprüfe deine eigenen Daten“. Die Idee von Whitebridge scheint also darin zu bestehen, beunruhigende persönliche Daten über Menschen zu generieren – und dann Geld für den Zugriff darauf zu verlangen. Artikel 15 DSGVO gibt Menschen jedoch das Recht, eine kostenlose Kopie ihrer Daten zu erhalten.

Lisa Steinfeld, Datenschutzjuristin bei noyb: „Whitebridge.ai verfolgt ein fragwürdiges Geschäftsmodell. Das Unternehmen zielt darauf ab, Menschen zum Kauf ihrer eigenen, unrechtmäßig erhobenen Daten zu bewegen. Nach EU-Recht haben Menschen das Recht, kostenlos auf ihre eigenen Daten zuzugreifen.“

„Unternehmerische Freiheit“ als Argument für DSGVO-Verletzungen? In seiner Datenschutzerklärung behauptet Whitebridge.ai lediglich, dass die Verarbeitung persönlicher Daten rechtmäßig sei und im Einklag mit der „Unternehmerischen Freiheit“ stehe. Damit ignoriert Whitebridge, dass jede Geschäftstätigkeit unter Einhaltung der Gesetze ausgeübt werden muss. Das beinhaltet auch die DSGVO. Aber das ist nicht alles: Whitebridge verfügt nicht einmal über eine Rechtsgrundlage für die Verarbeitung der persönlichen Daten. Stattdessen behauptet das Unternehmen, nur Daten aus „öffentlich zugänglichen Quellen“ zu verarbeiten. In Wirklichkeit stammen die meisten Informationen jedoch von sozialen Netzwerken, die weder indexiert sind noch über Suchmaschinen gefunden werden können. Der EuGH hat im Fall C-252/21 bestätigt, dass die Eingabe von Informationen auf Social Media nicht bedeutet, dass diese „offenkundig öffentlich gemacht“ wurden.

Lisa Steinfeld, Datenschutzjuristin bei noyb: „Der bloße Verweis auf die angebliche unternehmerische Freiheit berechtigt Whitebridge nicht, geltendes Recht zu ignorieren. Whitebridge sammelt alle persönlichen Daten, die es in sozialen Medien finden kann. Eine Rechtsgrundlage hat es dafür nicht.“

„Nacktheit“ oder „gefährliche politische Inhalte“. Um herauszufinden, ob auch sie betroffen sind, haben die Beschwerdeführer ihre eigenen Namen auf Whitebridge.ai gesucht. Sie stellten schnell fest, dass sie einen Bericht mit ihren Daten erwerben können. Beide Beschwerdeführer:innen reichten deshalb ein Auskunftsersuchen gemäß Artikel 15 DSGVO ein, erhielten jedoch keine Informationen. noyb kaufte die Berichte deshalb kurzerhand. Diese enthielten falsche Warnungen wegen „Nacktheit“ und „gefährlichen politischen Inhalten“. Laut Artikel 9 DSGVO gelten diese als besonders geschützte sensible Inhalte. Die Beschwerdeführer:innen beantragten deshalb kurz darauf eine Berichtigung gemäß Artikel 16 DSGVO. Anstatt dem nachzukommen, behauptete Whitebridge.ai jedoch, dass die Betroffenen eine qualifizierte elektronische Signatur benötigen würden, um ihre Rechte auszuüben, da „moderne KI-Technologien es zunehmend einfacher machen, überzeugende gefälschte Dokumente zu erstellen”. EU-Recht verlangt von niemandem eine solche Signatur.

Aitana Pallas, ebenfalls von noyb: „Die Menge an persönlichen Daten, die Whitebridge AI verarbeitet, ist äußerst beunruhigend. Das sagt sogar Whitebridge selbst in Werbevideos für seinen Service. Hinzu kommt, dass Whitebridge AI betroffene Personen einfach ignoriert, wenn sie ihre Rechte ausüben wollen.“

Beschwerde in Litauen eingereicht. noyb hat nun eine Beschwerde bei der litauischen Datenschutzbehörde eingereicht. Whitebridge.ai verstößt gegen mehrere DSGVO-Bestimmungen, darunter Artikel 5, 9, 12 und 16 DSGVO. Wir fordern Whitebridge.ai auf, den Auskunftsersuchen der Beschwerdeführer:innen nachzukommen und die falschen Daten in den Berichten über sie zu berichtigen. Wir fordern das Unternehmen außerdem auf, seinen Informationspflichten nachzukommen, alle rechtswidrigen Verarbeitungen einzustellen und die Beschwerdeführer über das Ergebnis eines Berichtigungsverfahrens zu informieren. Nicht zuletzt schlagen wir der Behörde die Verhängung einer Geldstrafe vor, um ähnliche Verstöße in der Zukunft zu verhindern.